Мы все прекрасно понимаем, как много значат эмоции в человеческом общении. Иногда взгляд, улыбка или нахмуренные брови рассказывают больше, чем слова. Современные технологии пытаются уловить и расшифровать эти тонкие сигналы с помощью анализа видео. В этом материале я расскажу, как именно работают такие системы, с какими вызовами они сталкиваются, и почему важно думать не только о технической стороне, но и о гуманитарной — этической.

Как работает распознавание эмоций по видео

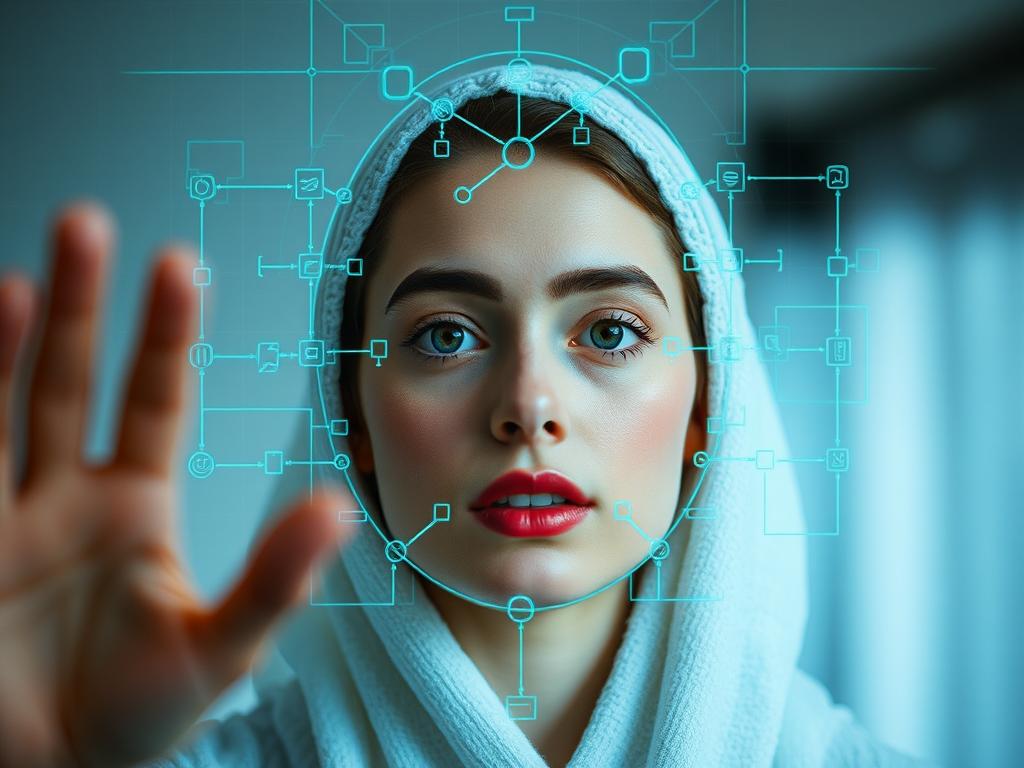

Основой таких систем служат алгоритмы компьютерного зрения и машинного обучения, которые анализируют выражение лица, положение головы, мимику и даже микровыражения. Камера фиксирует видео, а программа превращает увиденное в цифровые характеристики — точки на лице, углы изгибов губ, морщинки вокруг глаз. Затем модели обучаются распознавать закономерности, связывая эти данные с конкретными эмоциями: радость, гнев, удивление, грусть и так далее.

Важным элементом здесь выступают нейронные сети — они учатся на огромных массивах помеченных данных, чтобы понять, как человечество выражает чувства. Интересно, что разные культуры демонстрируют эмоции немного по-разному, а значит, универсальные алгоритмы должны учитывать контекст, чтобы не путать, например, выражение уважения с неодобрением.

Основные технологии, лежащие в основе

Не буду утомлять техническими терминами, но несколько ключевых направлений стоит упомянуть, чтобы понять, как устроено распознавание эмоций по видео:

- Слежение за лицом. Система находит лицо в кадре и фиксирует его положение.

- Анализ ключевых точек. Особые точки на лице — уголки глаз, носа, рта — становятся измерительными маркерами.

- Классификация выражений. На основе этих точек алгоритм определяет эмоциональное состояние, соотнося данные с шаблонами.

- Использование динамики. Эмоции обычно меняются со временем, поэтому анализируют не одно фото, а последовательность кадров.

Помимо этого, активно идут разработки в направлениях глубокого обучения и многомодальных данных, где кроме выражения лица учитывают голос, позу и движения тела.

Системы на практике: где уже применяется распознавание эмоций

Во многих случаях технологии уже помогают упростить и улучшить процессы. В маркетинге видеоанализ используется для определения реакции аудитории на рекламу или фильмы, что помогает создавать более цепляющий контент.

В медицине такие системы автоматизируют диагностику настроения, например при депрессии или тревожных расстройствах, выступая помощником для специалистов.

Также немало примеров в сфере безопасности — анализ поведения человека на видео помогает выявить подозрительные или неадекватные реакции, что актуально в аэропортах, на массовых мероприятиях или в транспортных системах.

Тонкая грань этики в использовании подобных технологий

Тут начинается самое интересное и одновременно сложное. Пока технологии совершенствуются, стоит внимательно подумать, где и каким образом их применять.

Во-первых, человеческое лицо — это не только набор данных. Личность, культура, обстоятельства, настроение — всё это влияет на выражение и интерпретацию эмоций. Автоматические системы не всегда могут уловить нюансы, и это чревато ошибками или неправильными выводами.

Во-вторых, вопрос приватности становится критически важным. Постоянное наблюдение и анализ эмоций без явного согласия человека напоминает о цифровом шпионаже. Без правил и ограничений такие технологии могут перейти границы допустимого вмешательства.

Нелегкая задача баланса

Не менее важны принципы прозрачности и ответственности. Люди должны знать, что их эмоции анализируются, а данные — надежно защищены. Организации, использующие подобные технологии, несут ответственность за этическое использование.

Для иллюстрации приведу ситуацию из реальной жизни: представьте, что вы обращаетесь в банк, где ваш эмоциональный фон сканируют в реальном времени. С одной стороны, это может помочь персоналу лучше понять ваше состояние и предложить нужные решения. Но с другой — вызываются вопросы о том, что происходит с вашими чувствами, насколько глубоко и корректно их интерпретируют, и как долго сохраняют эту информацию.

Современные вызовы и ограничения алгоритмов

Алгоритмы обучения не совершенны. Среди часто встречающихся проблем — предвзятость данных, из-за которой определенные группы людей распознаются с меньшей точностью. Есть риск усилить социальные разрывы и неравенство.

Также стоит учитывать, что эмоции не всегда выражаются открыто и однозначно. Стресс, маскирующий грусть, или улыбка из вежливости запутают любой компьютер. Это значит, что полагаться исключительно на машинный анализ эмоций опасно, особенно в сфер важных решений — медицине, образовании, правосудии.

Таблица: преимущества и риски распознавания эмоций по видео

| Преимущества | Риски |

|---|---|

| Ускорение и автоматизация анализа настроения | Ошибки интерпретации эмоций |

| Помощь в сфере медицины и психологии | Нарушение приватности и согласия |

| Оптимизация рекламных и сервисных предложений | Предвзятость и дискриминация |

| Повышение безопасности на общественных пространствах | Избыточный контроль и слежка |

Размышления о будущем: как сделать технологии полезными и этичными

Выход — в тщательном регулировании, привлечении междисциплинарных экспертов и открытом диалоге общества и разработчиков. Важно, чтобы технологии служили людям, а не становились инструментом давления или манипуляции.

Лично я считаю, что развитие должно идти параллельно с образованием пользователей и специалистов. Когда люди понимают возможности и ограничения распознавания эмоций, снижается страх и нарастает доверие.

Еще один путь — создание «этического кода» для разработчиков. Это набор рекомендаций, которые помогут избегать злоупотреблений и поддерживать баланс между инновациями и правом на личную жизнь.

Возможные векторы развития

- Интеграция с виртуальной и дополненной реальностью для более живого взаимодействия.

- Повышение точности с учётом культурных особенностей.

- Создание гибких систем, которые учитывают контекст и не делают поспешных выводов.

- Акцент на добровольность и информированное согласие пользователей.

Технологии анализа видео и эмоций — в каком-то смысле зеркало общества, показывающее наши мечты, страхи и ценности. Именно поэтому говорить о них стоит не только с техническими деталями, а и с человеческой стороны.